Bạn có bao giờ thắc mắc vì sao Chat GPT có thể làm thơ, hay cách xe tự lái nhận diện vật cản chỉ trong tích tắc?

Đằng sau những khả năng đó không phải là máy tính thông thường, mà là các máy chủ AI Deep Learning — những hệ thống tính toán mạnh mẽ được thiết kế chuyên biệt để huấn luyện và vận hành trí tuệ nhân tạo

Hãy cùng Megacore tìm hiểu về sức mạnh và lý do vì sao máy chủ AI Deep Learning lại là linh kiện đắt đỏ và được săn đón nhất hiện nay.

- Deep Learning là gì?

Deep Learning là một nhánh của trí tuệ nhân tạo (AI) tập trung vào việc sử dụng các mạng nơ-ron nhân tạo (neural networks) để mô phỏng quá trình học tập và xử lý thông tin của bộ não con người. Deep Learning hoạt động dựa trên mô hình mạng nơ-ron sâu (Deep Neural Networks) với nhiều lớp (layers) nơ-ron, cho phép máy tính học từ các dữ liệu đầu vào và đưa ra dự đoán hoặc phân loại dữ liệu một cách tự động.

Cách thức vận hành của Deep Learning

Mô hình mạng nơ-ron trong Deep Learning bao gồm nhiều lớp ẩn, mỗi lớp có hàng triệu nơ-ron nhân tạo. Các nơ-ron trong một lớp được kết nối với nơ-ron của lớp kế tiếp và trao đổi thông tin thông qua quá trình tính toán phức tạp. Mỗi nơ-ron có khả năng học hỏi từ dữ liệu thông qua điều chỉnh trọng số (weights) dựa trên đầu vào và đầu ra mong muốn. Quá trình học này được thực hiện thông qua thuật toán backpropagation (lan truyền ngược) nhằm giảm thiểu sai số giữa đầu ra dự đoán và thực tế.

Ứng ứng dụng của Deep Learning

Deep Learning có nhiều ứng dụng rộng rãi trong cuộc sống và các ngành công nghiệp như:

Nhận diện hình ảnh: Sử dụng trong các hệ thống nhận dạng khuôn mặt, phân loại ảnh, và xử lý hình ảnh y tế.

Xử lý ngôn ngữ tự nhiên (NLP): Sử dụng trong các ứng dụng dịch thuật, chatbot, và phân tích văn bản.

Hệ thống tự hành: Trong ô tô tự lái, Deep Learning giúp phân tích môi trường xung quanh thông qua camera và cảm biến.

Dự đoán và phân tích dữ liệu: Phân tích dữ liệu lớn trong các lĩnh vực như tài chính, y tế, và nghiên cứu khoa học.

2. Vì sao Deep Learning cần máy chủ chuyên dụng?

Deep learning không chỉ là việc chạy một vài thuật toán thông thường. Đây là quá trình huấn luyện các mô hình có cấu trúc phức tạp, sử dụng khối lượng dữ liệu khổng lồ và yêu cầu năng lực tính toán cực cao. Vì vậy, máy chủ AI Deep Learning được thiết kế riêng để đáp ứng những yêu cầu này, thay vì sử dụng máy tính phổ thông.

Dưới đây là ba lý do quan trọng giải thích vì sao deep learning cần một máy chủ AI chuyên dụng.

Khối lượng tính toán lớn

Trong deep learning, việc training mô hình như CNN (Convolutional Neural Network) cho nhận diện hình ảnh hoặc Transformer cho xử lý ngôn ngữ tự nhiên đòi hỏi hàng tỷ phép tính toán mỗi giây.

Nếu sử dụng máy tính thông thường, thời gian training có thể kéo dài hàng tuần hoặc thậm chí hàng tháng. Trong khi đó, Server AI Deep Learning với kiến trúc tối ưu có thể rút ngắn đáng kể thời gian huấn luyện, giúp doanh nghiệp tăng tốc phát triển sản phẩm AI và giảm chi phí vận hành.

Yêu cầu GPU hiệu năng cao

Thành phần quan trọng nhất của một máy chủ AI chính là GPU. Deep learning tận dụng khả năng tính toán song song (parallel computing) để xử lý hàng nghìn phép toán đồng thời.

GPU chuyên dụng cho deep learning thường sở hữu:

- Hàng nghìn CUDA cores

- Tensor cores tối ưu cho phép tính ma trận

- Dung lượng VRAM lớn để lưu trữ mô hình và dữ liệu

Nhờ đó, GPU có thể tăng tốc quá trình training lên nhiều lần so với CPU. Một hệ thống máy chủ deep learning đa GPU còn cho phép mở rộng hiệu năng theo nhu cầu, phù hợp cho các dự án AI quy mô lớn.

3. GPU nào tốt nhất cho Server AI Deep Learning?

Khi xây dựng Server AI Deep Learning, việc lựa chọn GPU phù hợp là yếu tố quan trọng nhất quyết định hiệu năng training và khả năng mở rộng hệ thống. Không phải mọi GPU đều giống nhau – mỗi dòng sẽ phù hợp với từng mục tiêu khác nhau như nghiên cứu, startup AI hay triển khai ở quy mô doanh nghiệp. Trong môi trường doanh nghiệp và datacenter, các dòng GPU chuyên dụng cho AI luôn là lựa chọn hàng đầu. Tiêu biểu là dòng NVIDIA A100 và NVIDIA H100 – những GPU được thiết kế riêng cho deep learning và AI server.

GPU NVIDIA A100:

- VRAM lớn (40GB – 80GB hoặc hơn)

- Tensor Cores tối ưu cho phép tính ma trận

- Hỗ trợ NVLink để kết nối đa GPU tốc độ cao

- Khả năng hoạt động ổn định 24/7 trong datacenter

Đây là lựa chọn lý tưởng cho: Training mô hình Transformer lớn , huấn luyện LLM và hệ thống AI doanh nghiệp

Ngoài ra còn có dòng GPU phổ biến hơn là RTX Series:

- Số lượng CUDA cores lớn

- Tensor cores hỗ trợ AI

- VRAM 16GB – 24GB (hoặc hơn)

- Dễ mua, dễ build hệ thống

Đây là giải pháp tối ưu cho: Nghiên cứu cá nhân, sinh viên AI, startup AI giai đoạn đầu

4. Lựa chọn cấu hình máy chủ Deep Learning phù hợp theo nhu cầu.

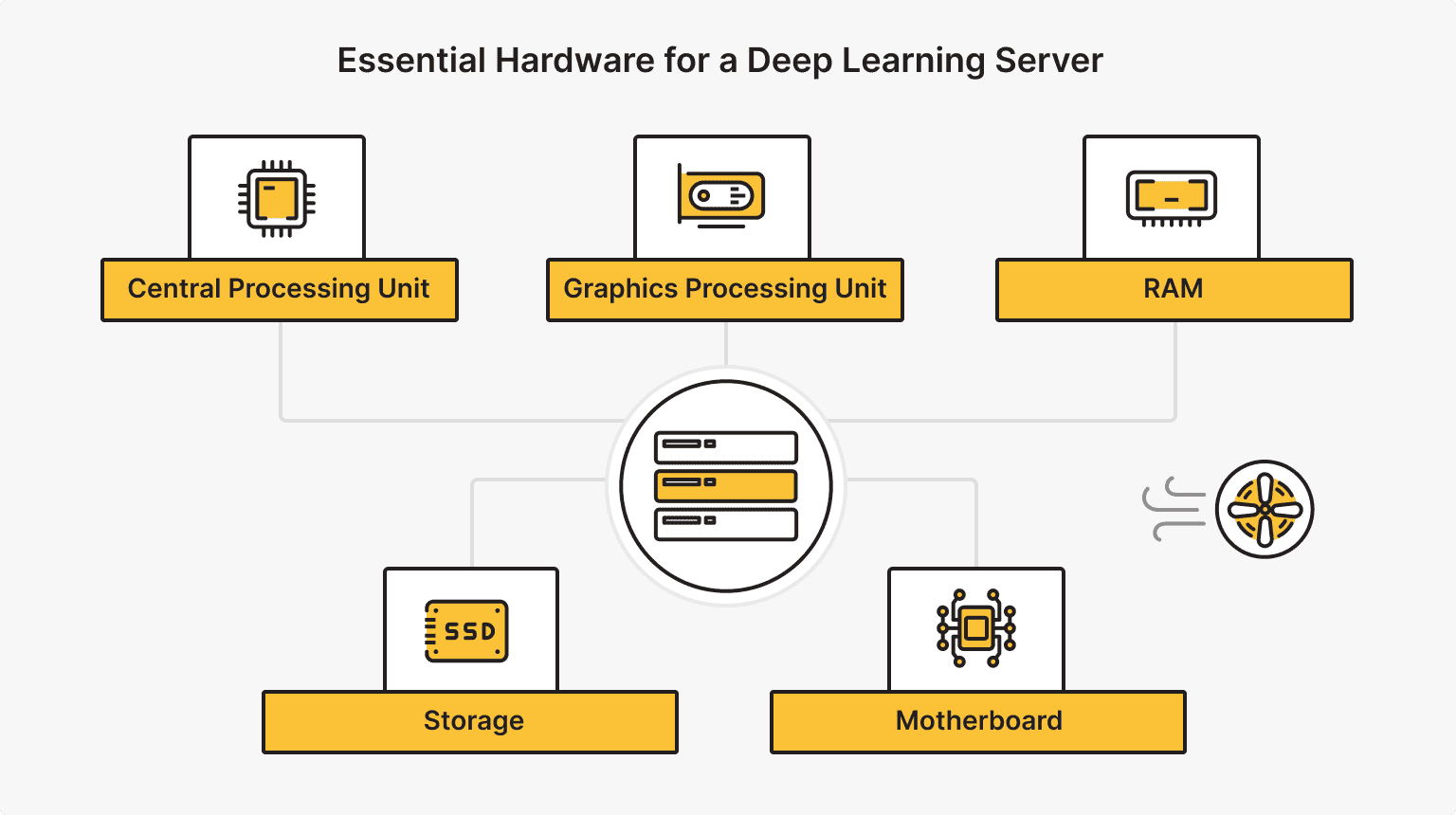

Để xây dựng một máy chủ deep learning mạnh mẽ và ổn định, bạn cần tối ưu đồng bộ nhiều thành phần phần cứng. Khác với server thông thường, server AI không chỉ tập trung vào CPU mà đặc biệt nhấn mạnh vào GPU, RAM dung lượng lớn và hệ thống lưu trữ tốc độ cao. Việc lựa chọn cấu hình phù hợp với từng nhu cầu sẽ giúp bạn không chỉ tối ưu chi phí mà còn rút ngắn thời gian phát triển sản phẩm, tăng lợi thế cạnh tranh và đảm bảo hệ thống AI vận hành ổn định 24/7.

Cho cá nhân

Nếu bạn là sinh viên, researcher hoặc kỹ sư AI làm việc với các mô hình vừa và nhỏ, bạn không nhất thiết phải đầu tư hệ thống quá phức tạp.

Gợi ý cấu hình máy chủ deep learning cho cá nhân:

- 1–2 GPU RTX VRAM 16GB–24GB

- CPU 16–24 cores

- RAM 64GB–128GB

- SSD 1TB–2TB

Cấu hình này đủ để:

- Huấn luyện mô hình CNN

- Làm việc với NLP cỡ trung

- Thử nghiệm kiến trúc mới

Cho Startup AI

Startup thường cần huấn luyện mô hình phức tạp hơn, xử lý dataset lớn hơn và yêu cầu thời gian training nhanh để rút ngắn chu kỳ phát triển sản phẩm.

Gợi ý cấu hình server deep learning cho startup:

- 2–4 GPU hiệu năng cao

- VRAM tối thiểu 24GB mỗi GPU

- CPU 32 cores trở lên

- RAM 128GB–256GB

- SSD hoặc SSD NVMe

Để tiết kiệm chi phí bạn nên chọn máy chủ deep learning có thể nâng cấp thêm GPU hoặc RAM trong tương lai mà không cần thay toàn bộ hệ thống.

Cho doanh nghiệp triển khai AI quy mô lớn

Doanh nghiệp lớn thường huấn luyện mô hình có hàng trăm triệu đến hàng tỷ tham số, hoặc vận hành nhiều pipeline AI song song.

Yêu cầu của máy chủ AI doanh nghiệp:

- 4–8 GPU datacenter trở lên

- VRAM 40GB–80GB mỗi GPU

- CPU nhiều nhân (dual CPU server)

- RAM 256GB–512GB hoặc hơn

- Hệ thống lưu trữ NVMe tốc độ cao

- RAID và backup dữ liệu

- Hạ tầng rack server chuyên dụng

Ở quy mô này, yếu tố ổn định 24/7 và độ tin cậy quan trọng hơn chi phí phần cứng ban đầu.

Cho Inference và triển khai Production

Không phải mọi hệ thống AI đều cần cấu hình cực mạnh. Nếu mục tiêu của bạn là inference (triển khai mô hình đã huấn luyện), yêu cầu phần cứng sẽ khác so với training.

Đặc điểm máy chủ deep learning cho inference:

- Ít GPU hơn (1–2 GPU có thể đủ)

- Tập trung vào độ ổn định và latency thấp

- CPU đủ mạnh để xử lý request đồng thời

- Tối ưu hóa năng lượng và chi phí vận hành

Trong production, điều quan trọng là:

- Thời gian phản hồi nhanh

- Khả năng xử lý nhiều người dùng cùng lúc

- Tính ổn định và khả năng scale theo traffic

Vì vậy, một server AI cho inference không cần VRAM quá lớn nhưng cần hệ thống mạng và hạ tầng ổn định.

Kết luận

Trong kỷ nguyên trí tuệ nhân tạo, máy chủ Deep Learning không còn là một lựa chọn xa xỉ mà đã trở thành nền tảng hạ tầng cốt lõi cho mọi dự án AI chuyên nghiệp. Nếu lựa chọn đúng ngay từ đầu, bạn không chỉ tối ưu chi phí mà còn rút ngắn thời gian phát triển sản phẩm, tăng lợi thế cạnh tranh và đảm bảo hệ thống AI vận hành ổn định 24/7.

Dù bạn là cá nhân nghiên cứu, startup công nghệ hay doanh nghiệp lớn, việc xây dựng máy chủ AI phù hợp sẽ là bước đi chiến lược giúp khai thác tối đa sức mạnh của deep learning trong thực tế.

Hiện tại Megacore đang cung cấp đến khách hàng các cấu hình máy chủ cho doanh nghiệp nhỏ cũng như các dịch vụ cho thuê máy chủ AI. Hãy liên hệ ngay với chúng tôi theo các thông tin bên dưới bài viết nếu như bạn có nhu cầu quan tâm đến dịch vụ này.